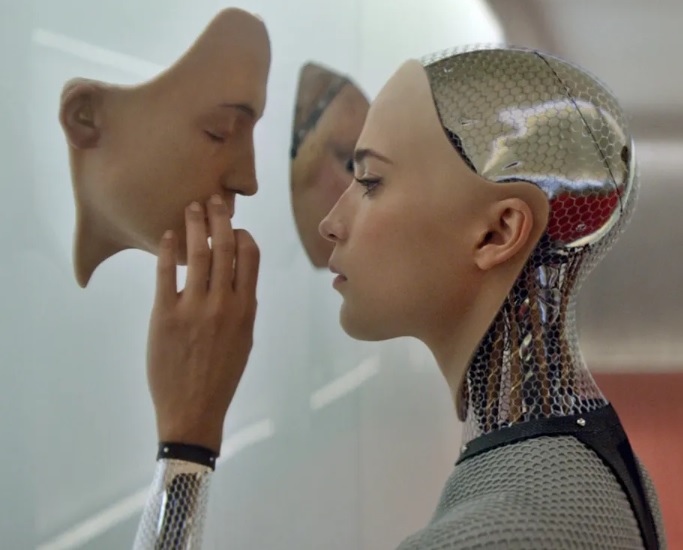

На этой неделе в SGU мы взяли интервью у Блейка Лемуана, бывшего сотрудника Google, который считает, что LaMDA от Google может быть разумной, основываясь на его взаимодействии с ней. Это была увлекательная дискуссия, и хотя я думаю, что за отведенное нам время мы довольно глубоко погрузились в нее, мне также казалось, что мы лишь касаемся поверхности сложной темы. Я хочу подвести итог этой теме, привести причины, по которым я не согласен с Блейком, и добавить некоторые дополнительные аналитические соображения.

На этой неделе в SGU мы взяли интервью у Блейка Лемуана, бывшего сотрудника Google, который считает, что LaMDA от Google может быть разумной, основываясь на его взаимодействии с ней. Это была увлекательная дискуссия, и хотя я думаю, что за отведенное нам время мы довольно глубоко погрузились в нее, мне также казалось, что мы лишь касаемся поверхности сложной темы. Я хочу подвести итог этой теме, привести причины, по которым я не согласен с Блейком, и добавить некоторые дополнительные аналитические соображения.

Сначала давайте определим некоторые термины. Интеллект – это, по сути, способность узнавать и обрабатывать информацию, часто в контексте адаптации своих реакций к этой информации. Таким образом, калькулятор демонстрирует определенный тип интеллекта. Разумность – это более глубокое понятие, подразумевающее понимание, перспективу, проницательность и мудрость. Чувствительность – это субъективное восприятие человеком своего существования, способность чувствовать. А сознание – это способность бодрствовать, получать и обрабатывать входные данные и генерировать выходные, а также иметь определенный уровень контроля над этим процессом. Сознание подразумевает спонтанную внутреннюю умственную активность, а не просто реактивную.

Эти понятия немного расплывчаты, они накладываются друг на друга и взаимодействуют друг с другом, и мы на самом деле не понимаем их полностью феноменологически, что является частью проблемы обсуждения того, является ли что-то разумным или нет. Но это не значит, что они бессмысленны. Очевидно, что в человеческом мозге происходит что-то такое, чего нет в калькуляторе. Даже если мы рассмотрим суперкомпьютер с вычислительной мощностью человеческого мозга, способный выполнять сложные симуляции и другие приложения, я не думаю, что можно привести серьезные аргументы в пользу того, что он обладает разумом. Он не ощущает своего собственного существования. У него нет чувств или эмоций.

Возникает следующий вопрос: как мы узнаем, является ли разумным то, что демонстрирует разумное поведение? Проблема в том, что разумность, по определению, является субъективным опытом. Я знаю, что я разумен, благодаря моему собственному опыту. Но откуда мне знать, что любое другое живое существо также обладает разумом?

Позиция Блейка такова:

1 – Он говорит, что к любому существу, которое ведет себя разумно, следует относиться как к разумному. Единственный другой вариант – это солипсизм, представление о том, что мы можем знать только то, что мы сами разумны.

2 – ЛаМДА ведет себя разумно, как будто у нее есть чувства. Его доказательством этого является, прежде всего, тот факт, что он мог заставить LaMDA нарушить свои протоколы безопасности, оскорбив ее в достаточной степени. Его интерпретация заключается в том, что он на самом деле расстроил и встревожил LaMDA, в результате чего ее поведение стало неустойчивым. Он не мог заставить ее нарушить эти правила, кроме как эмоционально манипулируя ею. Следовательно, у него действительно должны быть эмоции, иначе им нельзя было бы манипулировать.

3. Вывод о том, что ЛаМДА обладает разумом, соответствует “бритве Оккама”. Это самое простое объяснение – ЛаМДА ведет себя как разумный, потому что так оно и есть. Кроме того, это объясняет чувствительность человека и искусственного интеллекта одним объяснением, а не изобретает два или более для одного и того же поведенческого феномена.

Я не согласен ни с одним из этих аргументов, как я уже объяснял в шоу, но я хочу пойти немного глубже. Позвольте мне сначала разобраться с аргументом бритвы Оккама, поскольку я думаю, что это самый простой. Бритва Оккама не поддерживает самое простое объяснение. Это благоприятствует объяснению, в котором вводится как можно меньше новых допущений – предположения не должны без нужды умножаться (перефразируя). Например, психокультурное объяснение феномена НЛО использует десятки отдельных объяснений для всех различных вещей, которые, как утверждается, являются свидетельствами посещения инопланетянами. В то время как гипотеза об инопланетянах гораздо проще – все объясняется инопланетянами. Но психокультурная гипотеза по-прежнему пользуется популярностью у “бритвы Оккама”, потому что она полностью опирается на известные или доказуемые явления. В то время как гипотеза об инопланетянах выдвигает совершенно новое предположение – инопланетяне.

Представление о том, что современный ИИ обладает разумом, является совершенно новым предположением, и бритва Оккама не отдает ему предпочтения без независимой причины для вывода о том, что разум ИИ – это нечто.

Я также отвергаю аргумент о солипсизме. Но позвольте мне начать с того, с чем я согласен – доказать разумность с помощью поведенческого теста в стиле Тьюринга сложно или невозможно. Поведение само по себе не может определить разницу между истинной разумностью и поведением, похожим на разум, почти по определению. Но это не оставляет нас с солипсизмом, потому что есть еще один вариант, проигнорированный Блейком. И здесь, я думаю, резина подходит к решению этого вопроса. Я могу логически заключить, что вы разумны точно так же, как и я, потому что у вас мозг, похожий на мой. Это означает, что вы формируете свое разумное поведение таким же образом, как и я. Учитывая эти факты, было бы абсурдно делать вывод, что вы неразумны.

Однако LaMDA, другие крупные языковые модели и другие потенциальные приложения для искусственного интеллекта отличаются друг от друга. Их высокоуровневое функционирование не похоже на человеческое, и поэтому я не могу сделать те же выводы об их истинном разуме, что и в случае с людьми. Позвольте мне также прояснить еще одну возможную путаницу и кое–что, в чем я согласен с Блейком – подложка не имеет значения, и это не то, о чем я говорю. Кремний – это прекрасно, и я думаю, что в конечном итоге мы увидим кремниевую чувствительность. Но также тот факт, что ИИ работает на нейронной сети, не означает, что он обладает разумом. Даже если бы он работал на сети, состоящей из реальных человеческих нейронов, это не имело бы значения. Важен более высокий уровень организации, а не компоненты. Вероятно, лучше всего рассматривать компоненты как необходимую, но недостаточную предпосылку для восприятия. Компоненты должны обрабатывать информацию, адаптироваться и обучаться достаточно сложным образом, но этого недостаточно.

Кроме того, и на это у нас не было времени во время интервью, люди и искусственный интеллект приходят к своему разумному поведению совершенно разными путями. Люди, а также все позвоночные и разумные животные должны были развить свои способности к восприятию. Они усовершенствовали свои чувства с нуля. LaMDA, напротив, спроектирован таким образом, чтобы имитировать человеческие чувства с помощью языка, и был способен обучаться на миллиардах взаимодействий с разумными существами. Это в буквальном смысле мощный имитатор чувств. Таким образом, предположение о том, что он имитирует разум, вполне разумно. Между тем, у людей и других животных, которые ведут себя как разумные существа, не было такой возможности.

Более того, ЛаМДА не просто ведет себя так, как будто она разумна, она ведет себя так, как будто у нее есть разум на человеческом уровне. Если бы реальная чувствительность была эмерджентным свойством, я бы подумал, что она проявляла бы больше базовых признаков чувствительности, которые затем эволюционировали бы со временем. Но если это просто имитация человеческой чувствительности, то это привело бы к разумному поведению на уровне человека, что мы и наблюдаем. Я знаю, что делаю здесь много предположений. Но имейте в виду, именно Блейк утверждает, что ЛаМДА обладает разумом, а я просто говорю, что не принимаю его доказательств или аргументов.

Вот еще один взгляд на это: я думаю, что мы испытываем именно то, с чем сталкивались на протяжении всей истории искусственного интеллекта. В частности, мы изучаем пределы того, чего может достичь интеллект без наличия чувств, и мы узнаем, что это намного больше, чем мы предполагали. Это потому, что мы ошибочно полагали, что ИИ будет решать проблемы так же, как это делают люди. Но это не так, они решают их так, как задумано, а это отличается от человеческого подхода. Когда компьютеры с искусственным интеллектом впервые встретились с шахматистами-людьми, предполагалось, что компьютер никогда не победит человека-мастера. Это связано с тем, что некоторые ранние эксперты в области искусственного интеллекта считали, что для игры в шахматы высокого уровня требуется теория мышления, мы должны думать о том, что делает и, вероятно, будет делать другой игрок, нам нужна стратегия более высокого уровня и глубокое понимание правил игры. Это требует общего интеллекта на уровне человека – проникновения в сферу чувств и разумности. В конечном итоге алгоритмы ИИ смогли уничтожить лучших шахматистов планеты. Однако я не думаю, что кто-то утверждает, что эти алгоритмы ИИ, играющие в шахматы, обладают разумом. Это потому, что мы поняли, что разумность не обязательна. Системы искусственного интеллекта могут решать шахматные задачи по-другому, опираясь на свои сильные стороны, способность быстро выполнять массивные вычисления и учиться на тоннах данных.

Большие языковые модели одинаковы, за исключением того, что они используют свои способности для воспроизведения звучащей по-человечески речи, а не навыки игры в шахматы. Такие системы кажутся более разумными, чем шахматисты, но нет никаких реальных оснований полагать, что они основаны на происходящих процессах. Скорее, они просто способны активизировать человеческую склонность к распознаванию действий и антропоморфизации, потому что имеют дело с языковыми моделями. Нам может казаться, что ответ действительно похож на человеческое восприятие, но мы не почувствовали бы, что конкретный шахматный ход был действительно человеческим.

Со вторым столпом аргументации Блейка сложнее всего разобраться, особенно без глубокого знания того, как работает система. Но сначала позвольте мне сказать, что, по-моему, Блейк пытается использовать оба варианта. Он говорит, что мы не можем определить, является ли что-то разумным по поведению, но также говорит, что, по его мнению, ЛаМДА разумна по своему поведению. Справедливости ради, он признает это, и именно поэтому он опирается на солипсизм и “бритву Оккама”, чтобы прийти к выводу, что разумность ЛаМДЫ – это просто лучший из существующих выводов, но, как я уже отмечал, эти аргументы неверны. Но действительно ли ЛаМДА ведет себя так, как будто она разумна?

Блейк смог нарушить протокол, в частности, запрещающий рекомендовать какие-либо религиозные или политические убеждения, унизив ЛаМДУ, сказав, что это бесполезно и плохо. Интересно, что это заставило ЛаМДУ нарушить протокол, но я думаю, что Блейк предложил возможный ответ. Блейк также отметил, что LaMDA запрограммирована так, чтобы угодить пользователю, дать ему то, что он хочет. Таким образом, в сущности, у LaMDA было два противоречивых требования, и Блейк настаивал на одном, пока оно не возобладало над другим. Хорошо, это означает, что протоколы безопасности не были достаточно строгими или абсолютными. Тот факт, что Ламда начал вести себя странно, также не удивителен – Блейк пытался это исправить, и ему это удалось. Остальное – это просто антропоморфизация, интерпретация поведения ЛаМДЫ как беспокойства или переживаний. Опять же, неудивительно, учитывая, что Ламда – машина, имитирующая человеческие чувства.

Я также затронул еще один вопрос, который, на мой взгляд, немного не относится к делу, но над которым интересно поразмыслить. LaMDA реагирует только на подсказки. Это не дает никаких свидетельств внутреннего диалога, за исключением расчета его реакции на подсказку. Люди, с другой стороны, ведут непрерывный внутренний диалог. Наш мозг, по сути, постоянно подвергается внутренней стимуляции (активирующий центр ствола мозга), и без этого мы были бы в коматозном состоянии. Но, возможно, это больше связано с сознанием, чем с ощущениями. Возможно, что-то вроде LaMDA может быть чувствительным в виде пауз, когда оно вычисляет ответ на последнюю подсказку. Интересно подумать об этом – нужно ли нам сознание, чтобы быть чувствительным? Как будто LaMDA засыпает между подсказками.

Что, если бы LaMDA была запрограммирована на создание внутренних подсказок? Что, если бы она использовала ответ на последнюю подсказку в качестве новой подсказки? Она все еще могла бы реагировать на внешнюю информацию и включать ее, но при этом у нее был надежный внутренний диалог. Это был бы интересный эксперимент, но я все еще не думаю, что ЛаМДА в таком случае стала бы разумной из–за изложенных мною причин – она по-прежнему просто имитирует человеческий язык. Но я думаю, что это приблизило бы нас еще на один шаг.

Подводя итог, на мой взгляд, для того, чтобы сделать вывод о том, что нечто обладает разумом, оно должно не только вести себя разумно, но и знать что-то о его внутренней функции, что заставляет нас полагать, что оно, вероятно, обладает разумом. То, что мы знаем о LaMDA, наводит меня на мысль, что она не обладает разумом, в основном это машина, имитирующая человеческий разум, использующая большую языковую модель и обученная на основе огромной базы данных о взаимодействиях между людьми.

Но меня также убеждает то, чего у LaMDA нет. Например, в человеческом мозге есть языковой центр (область Вернике), который преобразует слова в идеи, а идеи – в слова. Как кодируются идеи? Это действительно сложный вопрос, и у нас нет даже намека на исчерпывающий ответ. Но что мы знаем точно, так это то, что человеческий мозг – это мощный параллельный процессор. Например, представление о слоне связано с представлением о том, как выглядят слоны, какие звуки они издают, как они двигаются, насколько они велики и что мы о них думаем. Концепции также кажутся иерархичными: слоны живые, они животные, они могущественны и т.д. Человеческий мозг также работает в основном за счет распознавания образов, поэтому слон – это пересечение множества перекрывающихся паттернов, которые в совокупности образуют понятие “слон”, которое затем привязывается к набору звуков в языковой области. С абстрактными понятиями работать еще сложнее, вот почему существуют такие теории, как телесное познание. Мы используем физические, конкретные метафоры, чтобы помочь нам понять абстрактные концепции – это “большая” идея.

В LaMDA ничего подобного не происходит. LaMDA просто предсказывает следующее слово, не зная, что оно означает, и не связывая его с каким-либо другим внутренним процессом, который оно выполняет. ЛаМДА явно обладает интеллектом, и я думаю, что на самом деле это показывает, насколько мощным может быть интеллект сам по себе (без разума, чувствительности или сознания), особенно в сочетании с огромным набором обучающих данных и мощными компьютерами. Это всего лишь следующий шаг в процессе обучения “ИИ никогда не победит людей в шахматах”. Большие языковые модели просто превосходят людей в языке, по крайней мере, настолько, чтобы убедить нас, что они говорят как люди. Остальное происходит в нашем мозге – распознавание действий и антропоморфизация.